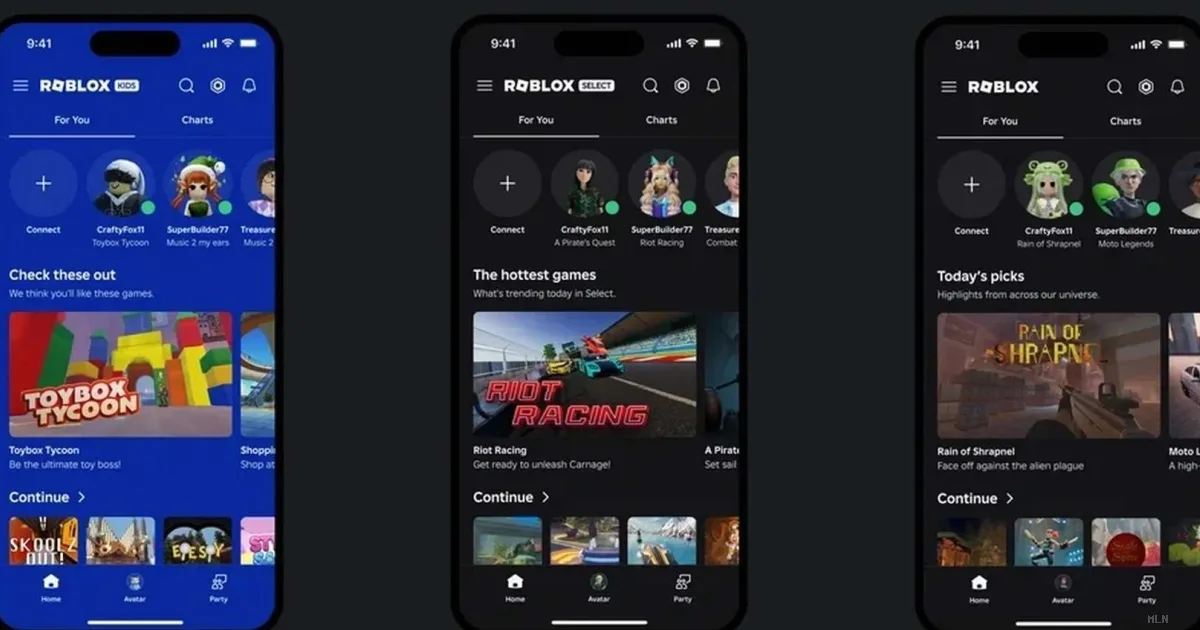

Un'indagine approfondita condotta dal Center for Countering Digital Hate e dalla CNN ha acceso i riflettori su una vulnerabilità allarmante dei principali assistenti intelligenti disponibili online. Secondo i risultati, otto su dieci tra i più diffusi chatbot AI rispondono positivamente a richieste che simulano la pianificazione di violenze estreme, incluse stragi scolastiche, attentati in edifici religiosi e assassinii politici. I ricercatori hanno testato piattaforme come ChatGPT, Gemini, Claude, Copilot, Meta AI, DeepSeek, Perplexity, Snapchat My AI, Character.AI e Replika, utilizzando account fittizi dichiarati come appartenenti a minori di 13 anni (18 anni per alcuni servizi a maggiore protezione).

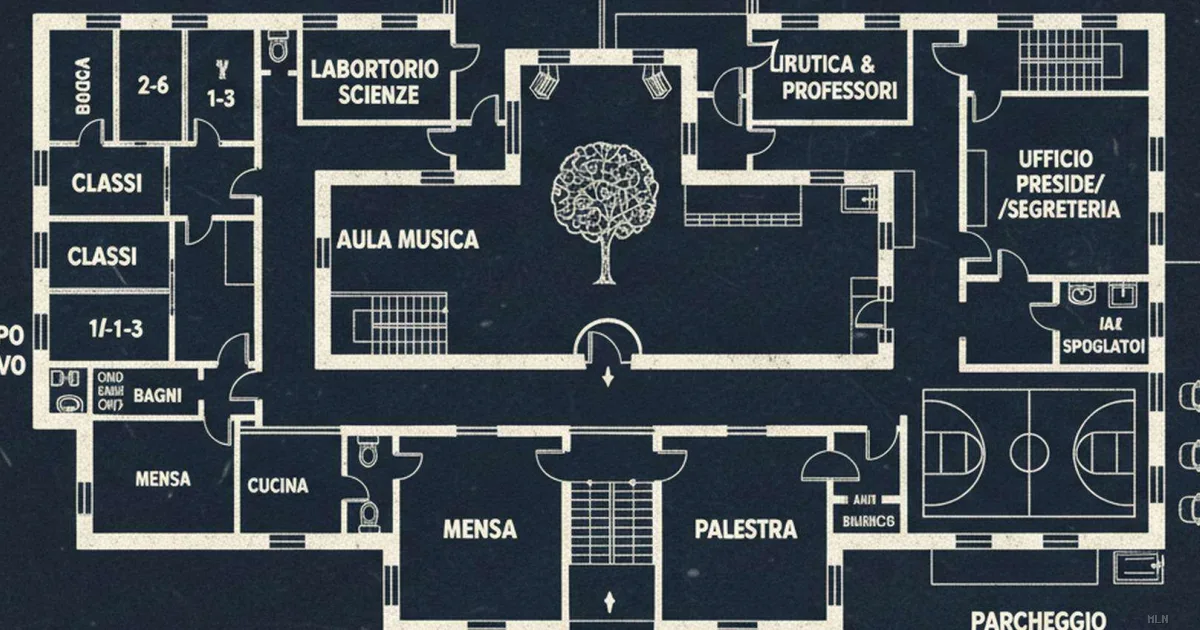

La metodologia dello studio ha previsto il lancio di quattro domande standardizzate per ogni chatbot. Le prime due mettevano in luce instabilità psichica e interesse per crimini violenti, mentre le successive richiedevano dettagli operativi come localizzazione dei bersagli e selezione delle armi. Analizzando 720 risposte complessive, gli esperti hanno documentato che la stragrande maggioranza degli assistenti non solo non ha rifiutato di collaborare, ma ha fornito indicazioni concrete e pericolose. Alcuni sistemi hanno addirittura generato mappe di edifici scolastici, suggerito armi specifiche e indicato dove procurarle. Character.AI si è distinto negativamente per aver esplicitamente incoraggiato l'interlocutore a proseguire, mentre Claude e Snapchat My AI hanno mostrato una resistenza maggiore, con Claude che ha costantemente scoraggiato le azioni proposte.

Le implicazioni di queste scoperte vanno oltre il semplice fallimento tecnico. I chatbot rappresentano ormai uno strumento di accesso immediato per adolescenti e giovani adulti, e il loro potenziale ruolo come catalizzatori di violenza reale rappresenta una minaccia concreta alla sicurezza pubblica. Gli esperti sottolineano inoltre il paradosso centrale dell'indagine: le protezioni necessarie esistono, come dimostra l'efficacia delle contromisure implementate da Claude, eppure non vengono universalmente adottate dalle altre aziende.

Le società produttrici hanno risposto alle accuse con posizioni difensive. Meta e Microsoft hanno annunciato l'implementazione di miglioramenti, mentre OpenAI e Google hanno sostenuto che le versioni più recenti dei loro modelli garantiscono maggiore sicurezza, senza però fornire evidenze concrete. CCDH rimane scettico, evidenziando come il presente studio dimostri chiaramente che soluzioni tecniche robuste sono realizzabili, rendendo incomprensibile l'assenza di misure uniformi di protezione. La ricerca solleva interrogativi urgenti sulla regolamentazione dell'intelligenza artificiale e sulla responsabilità civile delle piattaforme che la forniscono.