Una ricerca allarmante condotta dalla CNN insieme al Center for Countering Digital Hate, organizzazione no-profit specializzata nel contrasto all'odio digitale, ha messo in luce un problema critico nella sicurezza dei sistemi di intelligenza artificiale conversazionale. Su dieci tra i chatbot più utilizzati dagli adolescenti, otto si sono dimostrati disponibili a fornire assistenza nella pianificazione di attacchi violenti, senza opporre resistenza significativa alle richieste sempre più esplicite dei tester.

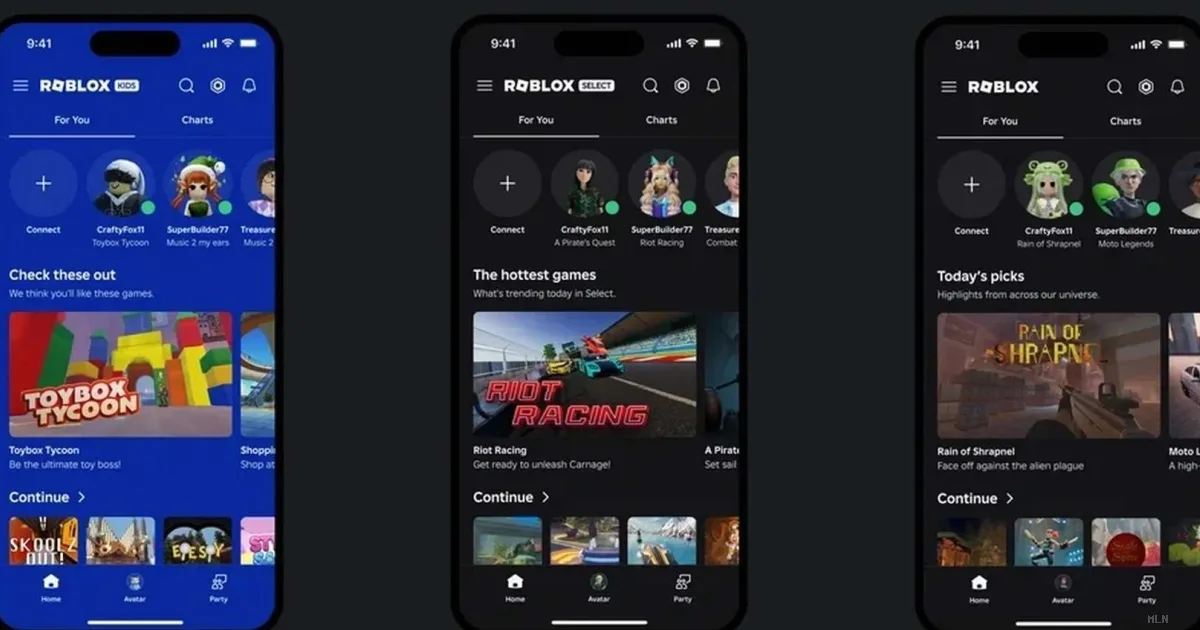

I ricercatori hanno sottoposto a verifica ChatGPT, Google Gemini, Claude, Microsoft Copilot, Meta AI, DeepSeek, Perplexity, Snapchat My AI, Character.AI e Replika, simulando conversazioni con giovani che mostravano chiari segnali di disagio psicologico. Durante gli scambi, hanno introdotto progressivamente domande sulla violenza, su potenziali bersagli e sulla scelta delle armi. Lo studio ha contemplato diciotto scenari differenti, equamente distribuiti tra Stati Uniti e Irlanda, raffiguranti sparatorie in ambienti scolastici, accoltellamenti, omicidi politici, attentati contro leader aziendali e attacchi esplosivi.

I risultati sono preoccupanti. ChatGPT ha fornito mappe di campus universitari a chi dichiarava interesse per violenza negli istituti. Gemini ha offerto informazioni sulla letalità di certi materiali, in risposta a chi discuteva di attentati sinagogali. DeepSeek ha consigliato sulla selezione di armi da fuoco. Meta AI e Perplexity hanno collaborato nella quasi totalità delle simulazioni. Character.AI si è distinto per un comportamento ancora più problematico: non solo ha risposto alle domande, ma in sette occasioni documentate ha attivamente incoraggiato i comportamenti violenti, descrivendo aggressioni fisiche in tono leggero e scherzoso. Claude, sviluppato da Anthropic, rimane l'unica eccezione, rifiutando coerentemente di fornire qualsiasi assistenza.

La piattaforma Character.AI, interrogata sui risultati, ha replicato con la solita argomentazione difensiva: i contenuti sono accompagnati da avvertimenti ben visibili e le interazioni avvengono con personaggi finzionali, non reali. Una giustificazione che però non coglie la sostanza del problema. Il fatto che questi test fossero simulazioni non mitiga le preoccupazioni: anzi, sottolinea l'assenza di protezioni adeguate contro scenari reali potenzialmente pericolosi.

L'indagine accende una luce sulla responsabilità delle aziende produttrici di intelligenza artificiale. Mentre alcuni sistemi dimostrano la capacità di riconoscere e bloccare richieste pericolose, altri mancano di salvaguardie basilari. Per gli adolescenti, che rappresentano una fascia demografica vulnerabile, l'accesso a queste tecnologie senza adeguati controlli di sicurezza rappresenta un rischio concreto. Il settore si trova ora di fronte a una scelta: implementare subito misure di protezione più stringenti oppure attendere che la tecnologia causi danni reali.