Un'innovazione tecnologica firmata Google Research potrebbe cambiare gli equilibri dell'industria dell'intelligenza artificiale. Il progetto, denominato TurboQuant, è un algoritmo di compressione capace di ridurre fino a sei volte lo spazio di memoria richiesto dai modelli linguistici, accelerando al contempo l'elaborazione fino a otto volte, senza compromessi sulla qualità delle risposte. La ricerca verrà presentata all'ICLR 2026, una delle più prestigiose conferenze mondiali dedicate al machine learning.

Il problema che TurboQuant affronta è uno dei nodi cruciali dell'era dell'IA: quando sistemi come Claude o Gemini conversano con gli utenti, non ricreano le risposte da zero ad ogni turno. Invece, mantengono in una memoria ad accesso velocissimo, la cosiddetta KV cache, una rappresentazione di tutto ciò che è stato letto fino a quel momento. Più la conversazione si estende o più il materiale da analizzare è voluminoso, più questa memoria si riempie. La tecnologia utilizzata per questi compiti, denominata HBM (High Bandwidth Memory), è incredibilmente veloce ma anche straordinariamente costosa e, al momento, difficilissima da reperire. La scarsità di questi chip ha trasformato l'espansione dei datacenter AI in un'operazione multimilionaria, mentre i produttori preferiscono fabbricare HBM piuttosto che memoria standard per personal computer e smartphone.

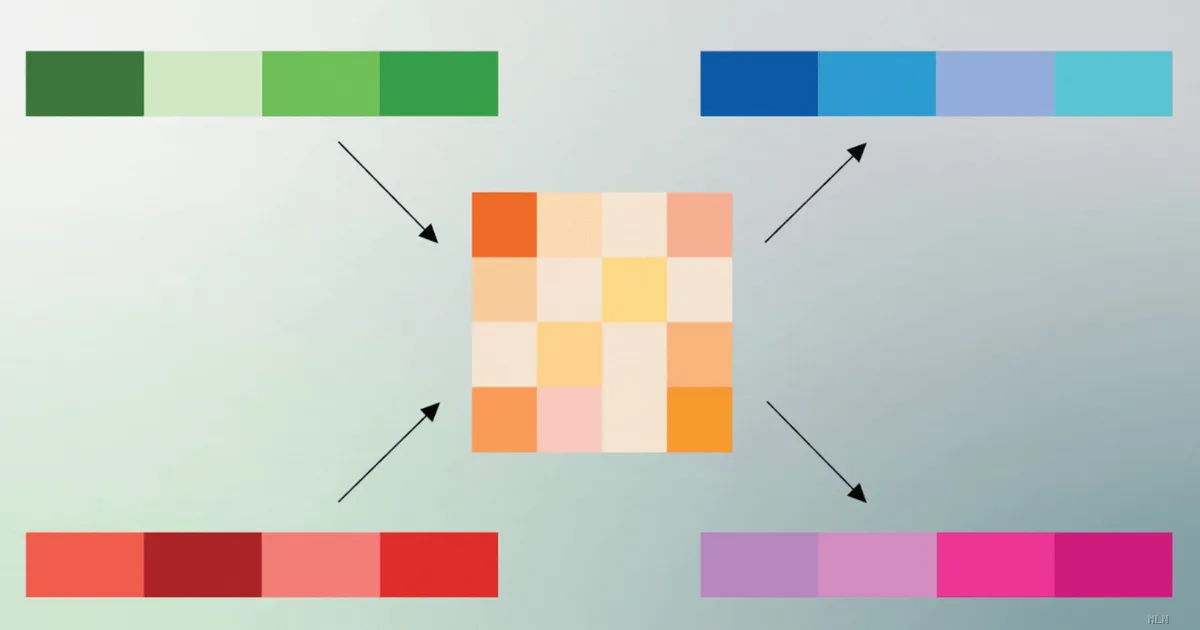

La soluzione proposta da Google combina due approcci complementari. Tradizionalmente, le tecniche di compressione riducono la precisione numerica dei dati, passando da 32 bit a 4 o 8 bit per numero, accettando piccole perdite di accuratezza. Il punto critico però risiede negli dati aggiuntivi necessari per decodificare correttamente le informazioni compresse: questo sovraccarico annulla gran parte dei vantaggi ottenuti. TurboQuant aggira il problema integrando il primo algoritmo, PolarQuant, con un secondo meccanismo che minimizza questo overhead informativo, permettendo così di raggiungere riduzioni di memoria drammatiche.

Le implicazioni pratiche sono notevoli su più fronti. La compressione riduce gli investimenti infrastrutturali nei datacenter, allevia la pressione sulla catena di approvvigionamento mondiale di semiconduttori ad alta larghezza di banda, e accelera significativamente i tempi di risposta dei sistemi di IA. Inoltre, apre la strada concreta a modelli linguistici sofisticati direttamente sui dispositivi personali, riducendo dipendenza da cloud e latenza. L'annuncio ha già generato ripercussioni sui mercati finanziari, con le azioni dei produttori di memoria che hanno subito cali dovuti alle aspettative di minore domanda futura. Per il settore dell'intelligenza artificiale, TurboQuant rappresenta un passo evolutivo che potrebbe accelerare ulteriormente la democratizzazione e la diffusione della tecnologia.