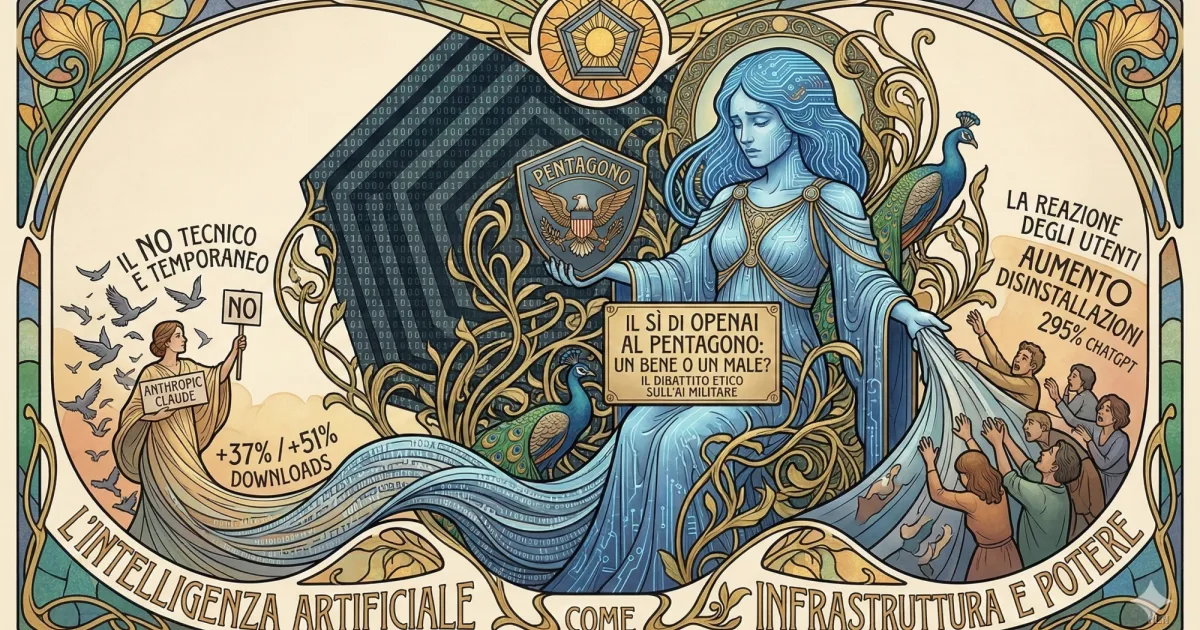

OpenAI ha ufficialmente siglato una partnership strategica con il Dipartimento della Difesa americano per implementare i propri sistemi di intelligenza artificiale all'interno delle reti militari protette. L'annuncio, condiviso direttamente da Sam Altman sulla piattaforma X, rappresenta un momento di svolta nella relazione tra il settore dell'IA e gli apparati di difesa statunitensi. La comunicazione di Altman è stata lapidaria: "Stasera abbiamo raggiunto un accordo con il Dipartimento della Difesa per schierare i nostri modelli nella loro rete classificata". Un messaggio che ha immediatamente catalizzato l'attenzione mediatica globale, oscurando notizie tecnologiche coeve come il rilascio di Nano Banana 2 da parte di Google.

Per contenere le polemiche, Altman ha deciso di illustrare pubblicamente i vincoli negoziati nell'accordo, sostenendo che OpenAI abbia inserito clausole etiche specifiche nel contratto. In primo luogo, i modelli non potranno essere utilizzati per sistemi di sorveglianza massiccia indirizzati contro cittadini americani. In secondo luogo, il patto include l'impegno a mantenere il controllo umano sulle decisioni critiche e il rifiuto di sviluppare armamenti completamente autonomi. In terzo luogo, l'accordo esclude esplicitamente agenzie di intelligence come la National Security Agency, che richiederebbe una contrattazione separata. Altman ha inquadrato la scelta come un compromesso strategico: partecipare al processo decisionale per imporre guardrail etici risulterebbe più efficace rispetto al rifiuto totale, che consegnerebbe il campo interamente ai militari.

Questa posizione contrasta nettamente con la scelta di Anthropic, società concorrente che ha declinato una proposta simile dal Pentagono. Le due aziende incarnano filosofie divergenti sul ruolo dell'IA nella geopolitica contemporanea: da un lato l'engagement negoziale, dall'altro il principio del non-coinvolgimento.

La decisione di OpenAI ha scatenato una reazione di massa tra gli utenti americani. Le disinstallazioni dell'applicazione mobile di ChatGPT hanno subito un'impennata vertiginosa del 295% in soli ventiquattro ore, considerando che la media giornaliera di rimozioni si assestava intorno al 9% nel mese precedente. Il malcontento si è riflesso anche nelle valutazioni pubbliche: le recensioni a una stella sono aumentate del 775%, mentre quelle a cinque stelle hanno registrato un crollo del 50%. Una forma di protesta silenziosa ma massiccia ha preso corpo attraverso i download, traducendosi in dati concreti di disapprovazione.

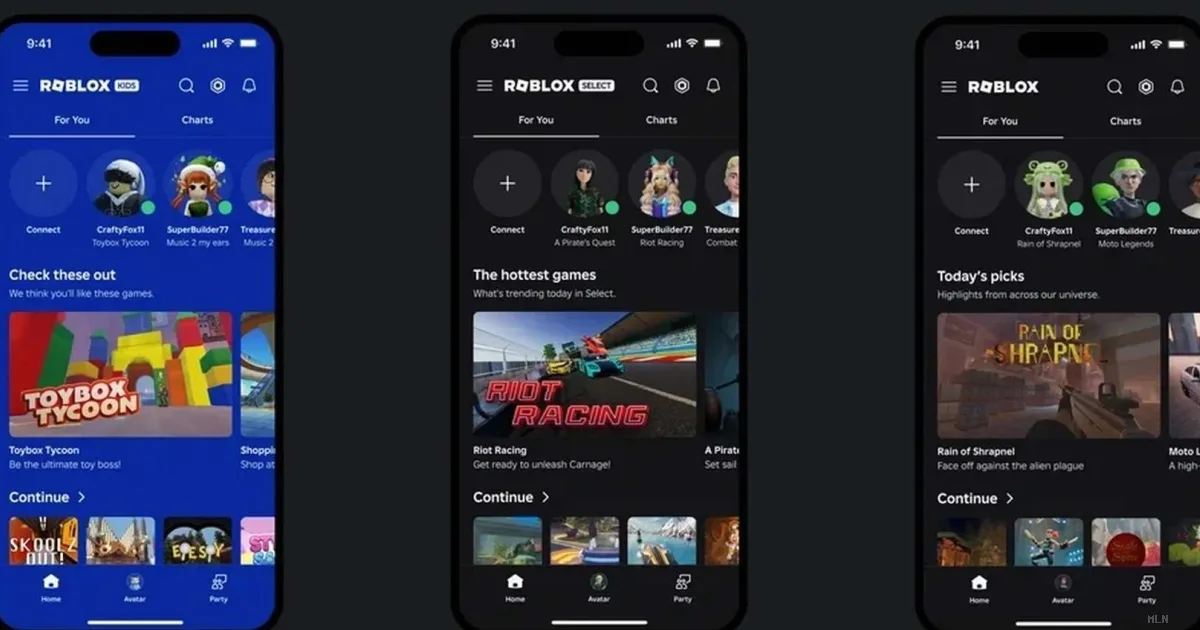

Parallelo a questo esodo, l'applicazione Claude di Anthropic ha beneficiato di un notevole incremento dei scaricamenti negli Stati Uniti, con un aumento del 37%. Il mercato si sta polarizzando lungo le linee di demarcazione etica tracciata dalle due società, trasformando una decisione commerciale in un referendum digitale sulla legittimità della cooperazione tra aziende tecnologiche e strutture militari.