Un'inchiesta condotta da diversi media internazionali, tra cui NPR e CNN, riporta che il sistema di identificazione bersagli utilizzato dalle forze armate americane potrebbe aver fatto ricorso al modello di intelligenza artificiale Claude, sviluppato da Anthropic, durante gli attacchi condotti contro l'Iran. In particolare, il bombardamento della scuola elementare femminile Shajareh Tayyebeh a Minab del 28 febbraio avrebbe causato circa 170 morti, prevalentemente bambine. Secondo le ricostruzioni giornalistiche, il colpo sarebbe stato sferrato da un missile Tomahawk lanciato dalla marina statunitense, benché CBS abbia specificato che si tratta di un attacco non intenzionale dal punto di vista delle operazioni americane.

L'analisi dei dati satellitari condotta da più redazioni ha evidenziato una circostanza rilevante: l'edificio scolastico si trova in prossimità del complesso militare Sayyid al-Shuhada controllato dalla Guardia Rivoluzionaria iraniana. Tuttavia, la struttura educativa è stata separata dalla base nel 2016 e trasformata in istituto per l'infanzia femminile. Il nodo cruciale della vicenda riguarda la possibilità che i sistemi di calcolo del targeting si fossero affidati a informazioni precedenti a tale separazione, continuando pertanto a classificare l'area come installazione militare operativa.

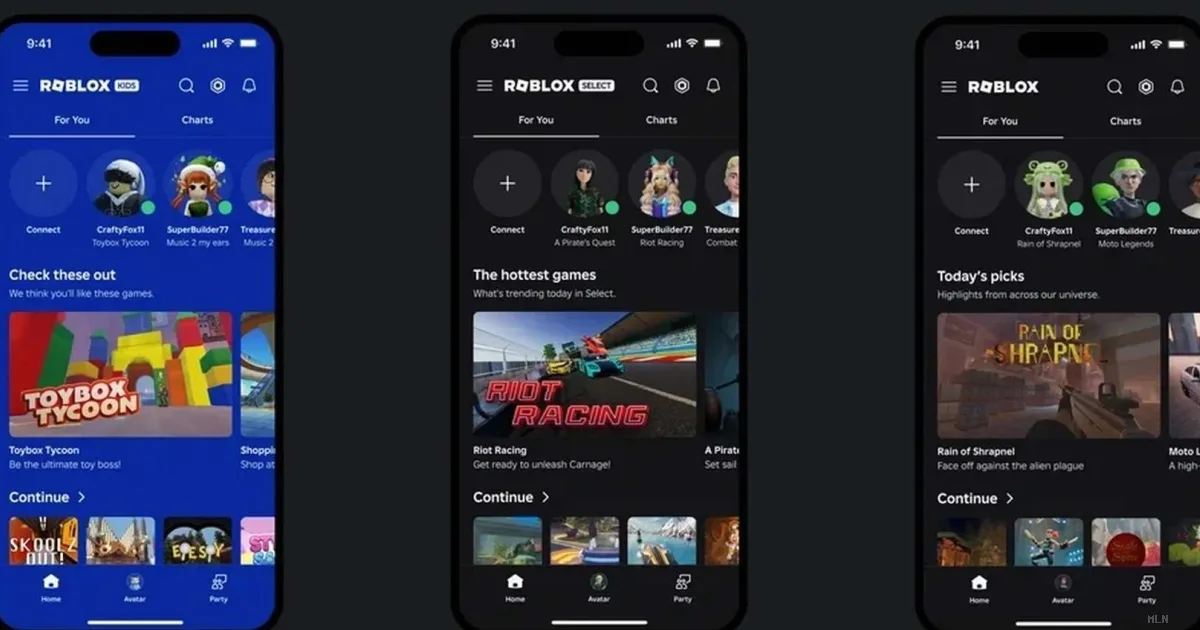

Il coinvolgimento dell'intelligenza artificiale appare legato al progetto Maven Smart System, una piattaforma realizzata da Palantir che integra immagini da satellite e dati provenienti da sistemi di sorveglianza al fine di identificare obiettivi militari potenziali. Questo sistema incorporerebbe appunto il modello Claude. Singolare il tempismo: subito dopo l'inizio delle operazioni statunitensi contro l'Iran, Anthropic ha rescisso i rapporti contrattuali con il Pentagono, rifiutando di sottoscrivere un accordo che prevedesse il monitoraggio diffuso della popolazione americana e lo sviluppo di armi autonome controllate dall'IA.

La posizione di Anthropic ha innescato una disputa legale: il Dipartimento della Difesa ha classificato l'azienda come fattore di rischio per la catena di approvvigionamento della difesa nazionale, una decisione che la società ritiene esagerata e ingiustificatamente punitiva. Al momento non esiste alcuna conferma ufficiale che Claude abbia direttamente individuato la scuola come bersaglio. Il Comando Centrale americano (CENTCOM), responsabile delle operazioni nel Medio Oriente, ha declinato di fornire chiarimenti sul ruolo dell'intelligenza artificiale, mentre il Dipartimento della Difesa ha limitato la propria comunicazione affermando che l'episodio è sottoposto a investigazione.